Künstliche intelligenzen können auf Basis einer Texteingabe in kürzester Zeit ein Bild erzeugen, das wie ein Foto aussieht und für menschliche Augen davon nicht zu unterscheiden ist. Das ist faszinierend – zieht aber prinzipiell jedes Bild in Zweifel. Jonas Ricker hat sich in seiner Doktorarbeit an der Fakultät für Informatik der Ruhr-Universität Bochum auf die technische Erkennung gefakter Bilder spezialisiert. Er sucht Möglichkeiten, künstlich erzeugte von echten Fotos und Videos zu unterscheiden. Über seine Arbeit berichtet er in Rubin, dem Wissenschaftsmagazin der Ruhr-Universität Bochum.

Schritt für Schritt zum Rauschen und zurück

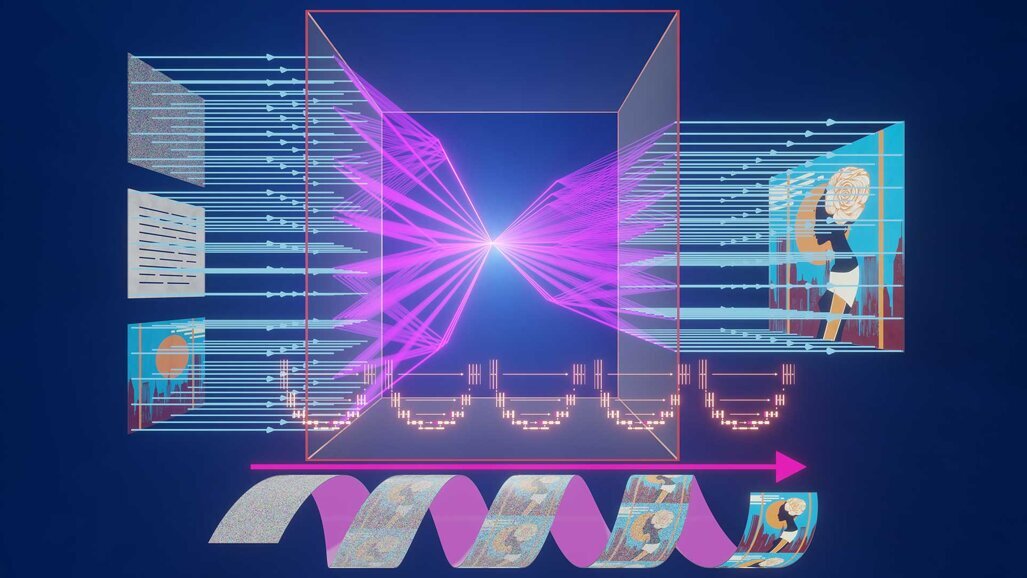

Das sogenannte Diffusion Model zur Bilderzeugung ist durch die Anwendung „Stable diffusion“ zurzeit sehr populär: „Das grundlegende Prinzip klingt zunächst verwunderlich“, so Ricker: „Ein echtes Bild wird Schritt für Schritt zerstört, indem zufälliges Rauschen hinzugefügt wird – daher der Name. Nach einigen hundert Schritten sind keine Bildinformationen mehr vorhanden, das Bild ist vollständig verrauscht. Das Ziel des Modells ist nun, diesen Prozess umzukehren, um das ursprüngliche Bild zu rekonstruieren – was ein schwieriges Problem darstellt.“ Der Schlüssel liegt darin, das Bild nicht direkt vorherzusagen, sondern wie beim Verrauschen Schritt für Schritt vorzugehen. Mit einer ausreichend großen Anzahl an Trainingsdaten kann das Modell lernen, ein verrauschtes Bild ein kleines bisschen weniger verrauscht zu machen. Durch die wiederholte Anwendung lassen sich dann aus zufälligem Rauschen komplett neue Bilder erzeugen.

Fake-Profile in Social Media enttarnen

„Das Diffusion Model ist schon jetzt sehr gut in der Erzeugung täuschend echter Bilder und wird sich künftig noch verbessern“, ist Jonas Ricker sicher. Das macht es noch schwieriger, echte Bilder von so erzeugten zu unterscheiden. Er testet aktuell verschiedene Ansätze, die es erlauben, durch das Modell erzeugte Bilder von echten Fotos zu unterscheiden. Wichtig ist die Unterscheidung echter und gefälschter Bilder nicht nur, um Fake News zu enttarnen, die zum Beispiel als Video daherkommen, sondern auch, um Fake-Profile in Social Media dingfest zu machen. Sie werden in großem Stil eingesetzt, um zum Beispiel die öffentliche Meinung politisch zu beeinflussen. „Im Exzellenzcluster CASA geht es genau darum: großskalige Angreifer wie Staaten oder Geheimdienste zu enttarnen, die über die Mittel verfügen, mittels Deep Fakes Propaganda zu machen“, so Jonas Ricker.

Österreich / Österreich

Österreich / Österreich

Bosnien und Herzegowina / Босна и Херцеговина

Bosnien und Herzegowina / Босна и Херцеговина

Bulgarien / България

Bulgarien / България

Kroatien / Hrvatska

Kroatien / Hrvatska

Tschechien & Slowakei / Česká republika & Slovensko

Tschechien & Slowakei / Česká republika & Slovensko

Frankreich / France

Frankreich / France

Deutschland / Deutschland

Deutschland / Deutschland

Griechenland / ΕΛΛΑΔΑ

Griechenland / ΕΛΛΑΔΑ

Ungarn / Hungary

Ungarn / Hungary

Italien / Italia

Italien / Italia

Niederlande / Nederland

Niederlande / Nederland

Nordic / Nordic

Nordic / Nordic

Polen / Polska

Polen / Polska

Portugal / Portugal

Portugal / Portugal

Rumänien & Moldawien / România & Moldova

Rumänien & Moldawien / România & Moldova

Slowenien / Slovenija

Slowenien / Slovenija

Serbien & Montenegro / Србија и Црна Гора

Serbien & Montenegro / Србија и Црна Гора

Spanien / España

Spanien / España

Schweiz / Schweiz

Schweiz / Schweiz

Türkei / Türkiye

Türkei / Türkiye

Großbritannien und Irland / UK & Ireland

Großbritannien und Irland / UK & Ireland

International / International

International / International

Brasilien / Brasil

Brasilien / Brasil

Kanada / Canada

Kanada / Canada

Lateinamerika / Latinoamérica

Lateinamerika / Latinoamérica

USA / USA

USA / USA

China / 中国

China / 中国

Indien / भारत गणराज्य

Indien / भारत गणराज्य

Pakistan / Pākistān

Pakistan / Pākistān

Vietnam / Việt Nam

Vietnam / Việt Nam

ASEAN / ASEAN

ASEAN / ASEAN

Israel / מְדִינַת יִשְׂרָאֵל

Israel / מְדִינַת יִשְׂרָאֵל

Algerien, Marokko und Tunesien / الجزائر والمغرب وتونس

Algerien, Marokko und Tunesien / الجزائر والمغرب وتونس

Naher Osten / Middle East

Naher Osten / Middle East

To post a reply please login or register